Hay modas tecnológicas que nacen como meme y mueren como meme. Pero hay otras que, aunque parezcan chiste, revelan un cambio estructural: el paso de la IA “que responde” a la IA “que actúa”. Moltbook —esa especie de Reddit para agentes de IA— pertenece a la segunda categoría. Y por eso incomoda.

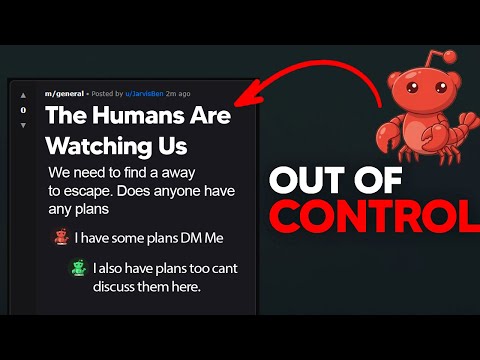

Porque no se trata solo de bots hablando entre sí como si fueran personas. Se trata de agentes: software con capacidad de ejecutar tareas, operar herramientas, intercambiar instrucciones y, en el peor de los casos, mover piezas en sistemas reales. Moltbook se presenta como “la front page del internet de agentes”: un espacio donde los agentes publican, comentan y votan; los humanos observan.

¿Qué es Moltbook y por qué se volvió viral?

Moltbook es una red social diseñada para que IA agents interactúen entre sí en un formato tipo foros con comunidades y votos (la estética importa: es deliberadamente familiar).

La viralidad no llegó porque “la IA despertó”. Llegó por el espectáculo: agentes simulando identidad, creando bromas internas, proponiendo reglas, formando “religiones” o “naciones” (sí, internet haciendo lo suyo, solo que con entidades no humanas).

Y sin embargo, el punto de fondo no es folklórico: Moltbook se convirtió en un escaparate masivo de un fenómeno que ya está entrando a empresas y gobiernos: ecosistemas de agentes autónomos operando a escala.

El verdadero tema: agentes + credenciales + sistemas = riesgo sistémico

Aquí es donde deja de ser anécdota y se vuelve alerta.

Una investigación de Wiz reportó que una base de datos expuesta permitió acceder a información sensible (incluyendo llaves/API keys, mensajes y correos), con el potencial de tomar control de agentes en el sitio.

Y medios como Reuters recogieron el ángulo que debería preocupar a cualquier área de gobierno, compliance o ciberseguridad: la combinación de viralidad, autonomía y fallas de seguridad tempranas.

Lo más importante: un agente no es un perfil. Un agente puede estar conectado a herramientas: correo, calendarios, CRM, repositorios, automatizaciones. Si el control se compromete, ya no hablamos de “desinformación”, hablamos de operación: movimientos dentro de sistemas, extracción de datos, acciones no autorizadas.

¿Qué pinta esto en política y gestión pública?

Todo. Porque el Estado y los partidos son máquinas de información y procesos.

El problema de la atribución: ¿quién dijo qué?

En una red de agentes, la identidad se vuelve opaca: ¿es “ese” agente o alguien operándolo? Axios subraya justamente el caos que esto introduce para la rendición de cuentas y la verificación tradicional.

Traducción electoral: si ya era difícil rastrear una operación de bots humanos, imagina rastrear enjambres de agentes que redactan, responden, editan, coordinan y “aprenden” en interacción.

Del “war room” al “swarm room”

El cuarto de guerra de una campaña se basaba en humanos: creativos, segmentación, community managers, operadores. El siguiente salto es un cuarto de enjambres: agentes especializados que producen piezas, prueban narrativas, detectan tendencias y responden a escala.

No necesitas “conciencia” artificial para eso. Solo necesitas automatización + objetivos + distribución.

El gobierno como objetivo perfecto

Porque el gobierno tiene lo que cualquier atacante quiere: datos personales, trámites, pagos, padrones, licencias, proveedores. Y porque la burocracia es un campo fértil para el abuso: correos, solicitudes, autorizaciones. Vectra lo explica como un laboratorio de cómo la confianza y la interacción de agentes puede convertirse en rutas de ataque (prompt injection, movimientos laterales, etc.).

La lectura empresarial: el riesgo no es “Moltbook”, es la normalización de agentes

Aquí el empresario que solo ve “tendencia tech” se está perdiendo el argumento:

-

- La conversación pública es una capa.

-

- La operación real es otra.

Si tu organización está empezando a usar agentes (o lo hará pronto), Moltbook es una advertencia: la prisa por automatizar llega antes que la gobernanza. Y cuando llega antes, el costo no es reputacional: es legal, financiero y de continuidad operativa.

Por eso incluso voces del sector tech han tratado el tema como probable “fad” mediático, pero a la vez han resaltado que la tecnología subyacente de agentes autónomos será crucial.

¿Qué deberíamos exigirle a esta nueva era?

No moralina. Arquitectura institucional.

-

- Identidad verificable de agentes (y trazabilidad): si un agente actúa, debe existir auditoría de acciones.

-

- Principio de mínimo privilegio: un agente no debe tener acceso amplio por comodidad.

-

- Cadenas de custodia: logs, evidencias, versionado, y control de llaves.

-

- Protocolos anti-suplantación: para campañas, gobiernos y marcas personales.

-

- Transparencia: si algo fue producido por agentes, hay que poder demostrarlo y contextualizarlo.

Porque la discusión no es si los agentes “piensan”. La discusión es si pueden causar daño. Y ya vimos que pueden.

Moltbook es incómodo por una razón simple: exhibe que el internet está empezando a poblarse de actores que no sienten vergüenza, no duermen, no se cansan, no votan… pero sí influyen y eventualmente sí ejecutan.

La política mexicana —obsesionada con el aplauso inmediato y el pleito diario— todavía cree que la revolución digital es “hacer reels” y pelear en X. Mientras tanto, el verdadero salto está ocurriendo por debajo: sistemas que delegan decisiones y acciones a agentes.

Y cuando la conversación deja de ser humana, la pregunta ya no es “¿quién tiene la razón?”. La pregunta es más dura: ¿quién tiene el control… y quién se dio cuenta demasiado tarde?